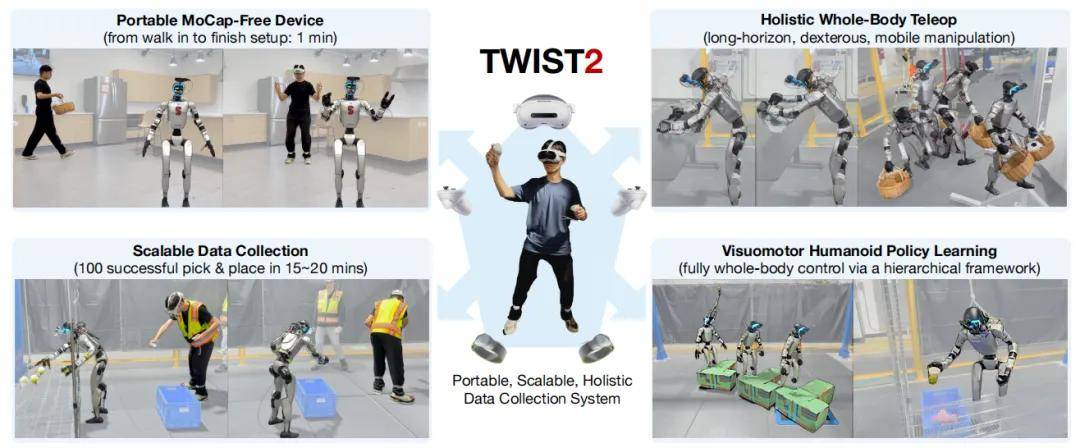

总成本1250 美元!1分钟部署!TWIST2打造低成本人形机器人数据采集方案!

在人形机器人领域,数据驱动的革命虽已到来,却始终受困于高效的数据采集框架。现有系统要么依赖昂贵且笨重的动作捕捉(MoCap)设备,要么牺牲全身控制能力换取便携性,难以实现规模化、高灵活性的开发。

近日,来自亚马逊FAR、斯坦福大学、加州大学伯克利分校等机构的团队提出了TWIST2,这是一套兼具便携性、可扩展性和全身体控能力的人形机器人遥操作与数据采集系统。它不仅打破了动捕设备的束缚,还能让机器人自主完成折纸、踢箱子等复杂任务,目前相关研究成果已开源。

▍告别动捕,1分钟部署的全身控制方案

传统人形机器人遥操作系统陷入两难:要么像TWIST等方案那样,依赖专业动捕实验室实现全身控制,却无法便携部署;要么像AMO、CLONE等VR-based方案那样追求便携,却只能实现局部身体控制,难以完成复杂协调任务。

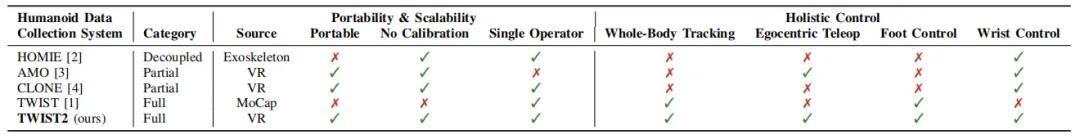

人形机器人数据采集系统对比

人形机器人数据采集系统对比

TWIST2的核心创新是“无动捕+全身体控”的深度融合,关键在于三大核心组件:

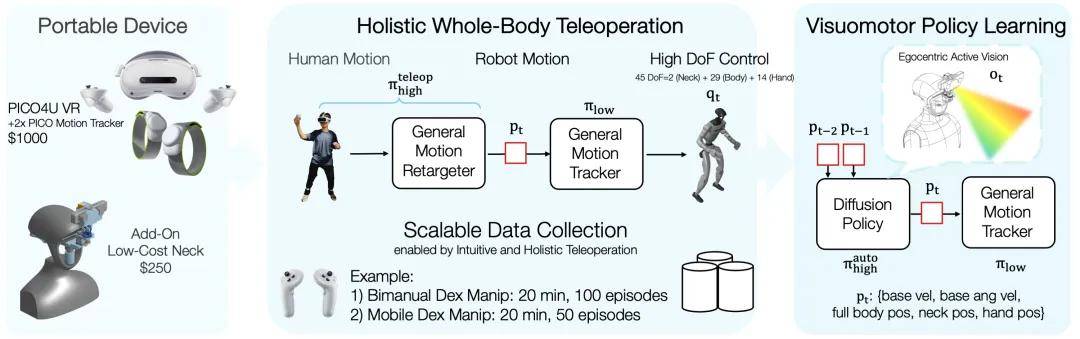

TWIST2系统概述

TWIST2系统概述

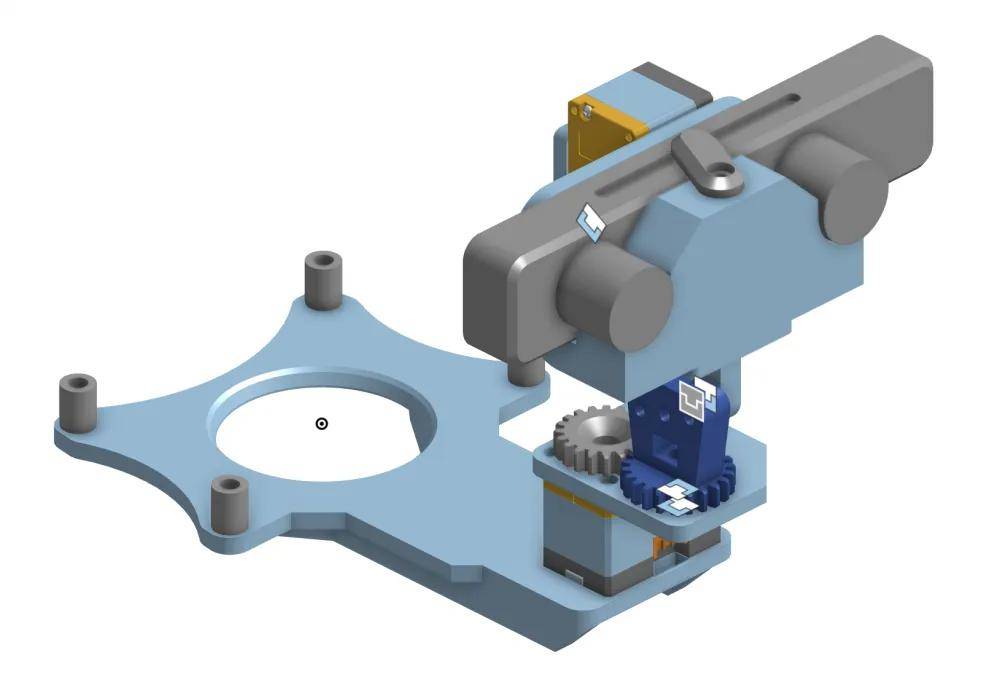

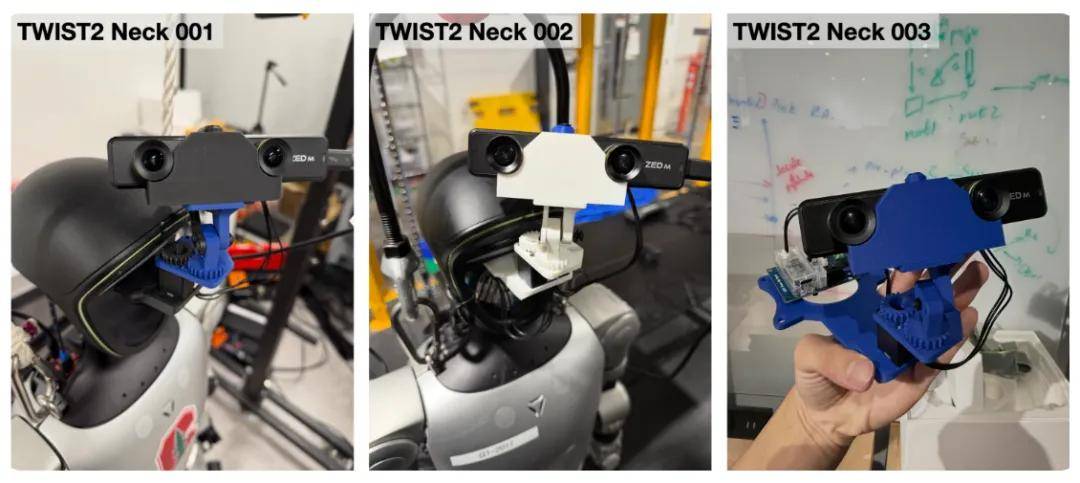

1. 低成本可拆装颈部:实现第一视角自主观察

团队设计了一款仅需250美元的2自由度(俯仰+偏航)颈部模块(TWIST2 Neck),可直接加装在Unitree G1机器人上,无需拆卸原有头部结构。搭配400美元的Zed Mini立体相机,机器人能获得与人眼类似的第一视角(egocentric)视觉能力,灵活调整观察角度,这解决了固定相机视野受限的问题,是完成长时任务的关键。

TWIST2颈部模块(TWIST2 Neck)

TWIST2颈部模块(TWIST2 Neck)

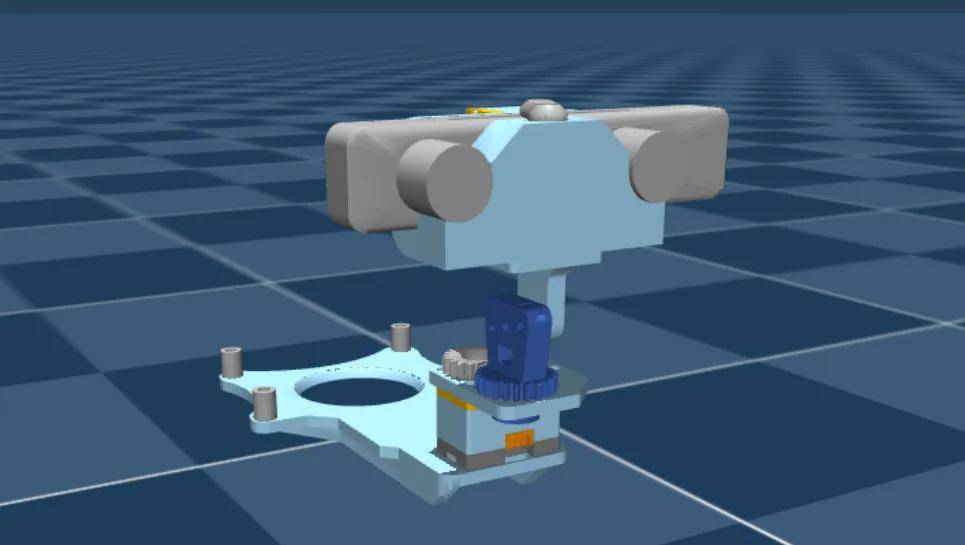

MuJoCo中的TWIST2颈部模块(TWIST2 Neck in MuJoCo)

MuJoCo中的TWIST2颈部模块(TWIST2 Neck in MuJoCo)

更关键的是,团队还为该颈部模块开发了MuJoCo仿真模型,方便研究者在虚拟环境中快速验证算法。

2. 便携VR动捕方案:1000美元搞定全身动作采集

不同于动辄数十万美元的光学动捕系统,TWIST2采用PICO 4U VR设备+2个腿部运动追踪器的组合,整套硬件成本仅约1000美元。这套设备无需复杂校准,从开箱到完成部署仅需1分钟,能以100Hz的频率实时捕捉人体全身动作,包括躯干、四肢的姿态变化。

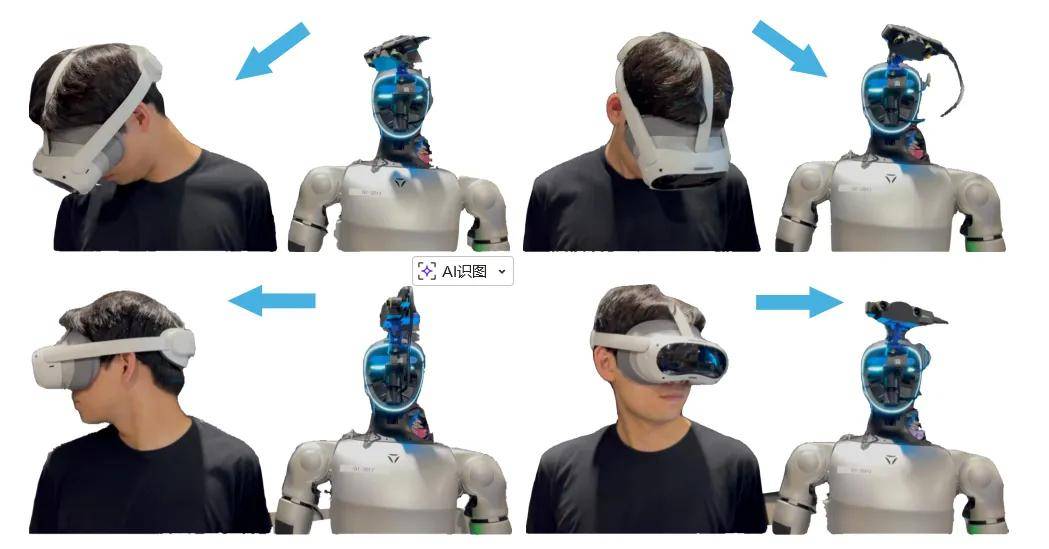

通过机器人颈部模拟人类颈部动作:研究团队发现,一款具备两个自由度(偏航角yaw与俯仰角pitch)的颈部模块,便足以模拟人类颈部的主要运动方式。

相比波士顿动力使用的HTC Vive Tracker,PICO方案无需额外第三方摄像头,灵活性更强,更适合“随时随地”的数据采集。

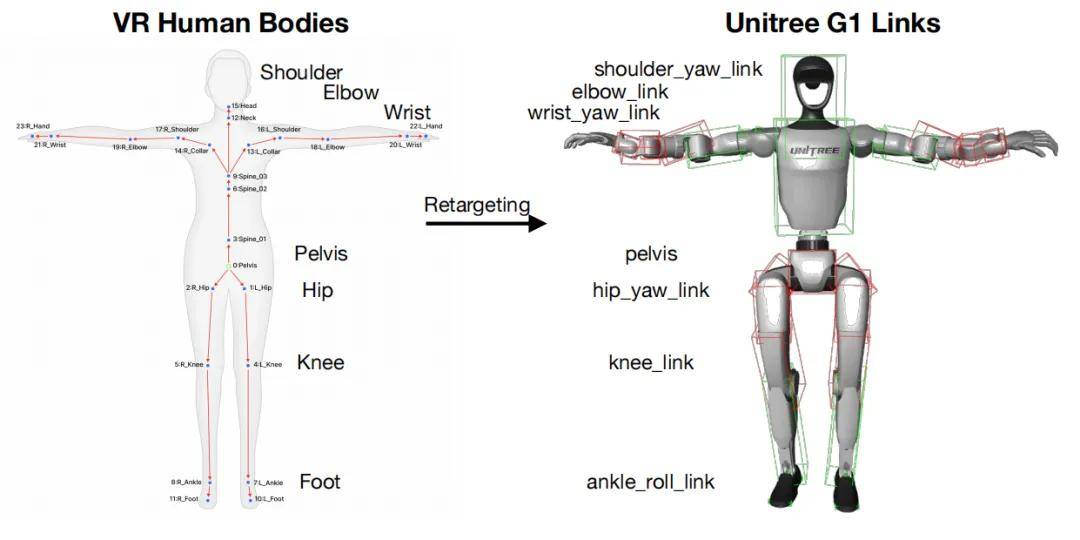

3. 精准动作重定向:从人类动作到机器人的无缝映射

捕捉到人类动作后,如何让机器人精准复现?TWIST2优化了基于GMR的动作重定向算法,针对VR动捕的特点做了关键改进:

VR人体至机器人连杆的映射

VR人体至机器人连杆的映射

- 下半身:同时优化位置和旋转约束,减少机器人脚部滑动;

- 上半身:仅优化旋转约束,避免全局姿态跳跃(如teleport 操作)带来的动作失真;

- 手部:将人类五指动作简化为“开合”控制,适配Unitree Dex31三指手,通过VR手柄按钮即可灵活控制抓取力度;

- 颈部:通过计算人类头部与脊柱的相对旋转,映射为机器人颈部的俯仰和偏航角度,实现视觉跟随。

▍高效数据采集:20分钟搞定100次成功演示

数据采集效率是制约人形机器人研究的核心瓶颈之一。TWIST2通过“单人操作+低延迟+智能过滤”,实现了规模化数据采集:

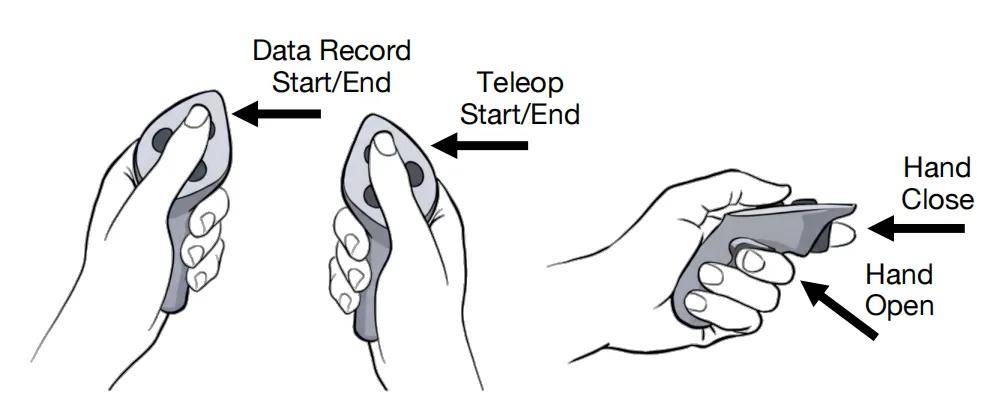

以往系统要么需要两人分工控制上下身,要么需要专人负责启停。TWIST2将PICO手柄设计为控制中心,操作员可独立完成任务启动、暂停、终止等所有操作。暂停时系统会自动插值过渡动作,避免机器人姿态突变,保障长时间安全运行。

PICO设备中遥操作者的视角:机器人所捕捉的视觉画面会悬浮显示在(视野的)中央位置。

整套系统的数据流频率均高于50Hz,总延迟低于0.1秒(远优于前代TWIST的0.5秒)。操作员通过PICO头显接收机器人的第一视角立体画面,能清晰感知深度信息,轻松完成精细操作。

基于PICO手柄的TWIST2单人操控系统及安全控制说明

基于PICO手柄的TWIST2单人操控系统及安全控制说明

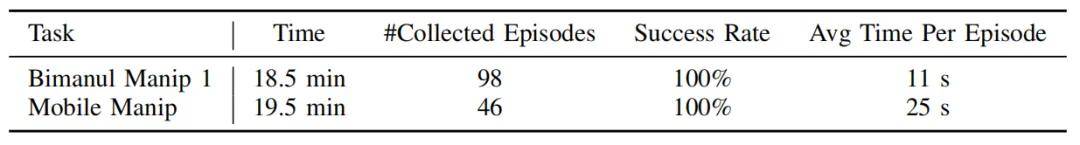

实验显示,熟练操作员使用TWIST2,20分钟内可完成:

- 98次成功的双手抓取放置任务,平均每次仅需11秒,成功率100%;

- 46次成功的移动抓取任务(如开门运物),平均每次25秒,成功率100%。

此外,用户研究还证明了核心组件的必要性:移除立体视觉会导致抓取位置偏差,移除颈部模块会限制视野,而放弃第一视角则无法完成远程移动任务。

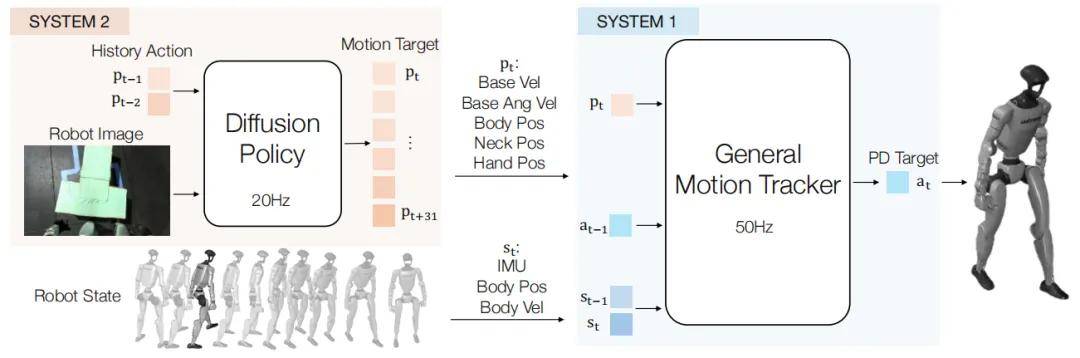

▍自主控制能力:基于视觉的全身自主决策

在成功采集高质量数据的基础上,团队进一步提出了分层视觉运动策略框架,让机器人彻底摆脱人类遥控,实现自主任务执行。这一框架采用清晰的分层控制架构,其中底层控制器是基于强化学习训练的通用运动追踪器,它会接收参考动作指令(如身体关节位置、基座速度)以及机器人自身的本体感觉数据(包括IMU和关节编码器数据),经过处理后输出关节目标位置,再通过PD控制器生成扭矩来驱动机器人运动;高层控制器则是基于扩散模型(Diffusion Policy)的视觉运动策略,它以机器人的第一视角图像和历史指令序列作为输入,能够直接预测未来2秒内的全身动作指令,并将其传递给底层控制器执行。

基于TWIST2的分层全身视觉运动策略学习框架

基于TWIST2的分层全身视觉运动策略学习框架

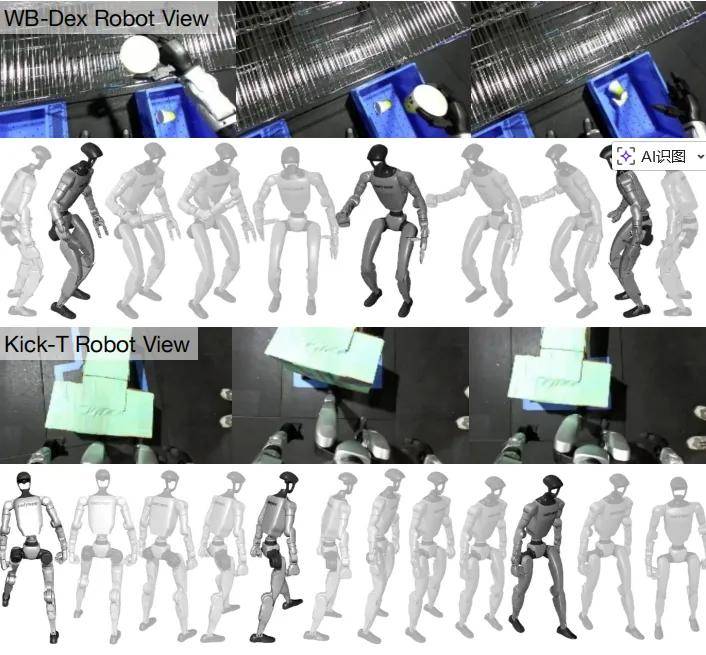

经过充分的数据训练后,搭载该框架的机器人成功自主完成了两项复杂任务,充分验证了其自主控制能力。

WB-Dex(全身灵巧抓取放置)与Kick-T(T型箱踢击)任务训练演示的可视化呈现(包含机器人第一视角画面及全身关节位置数据)。

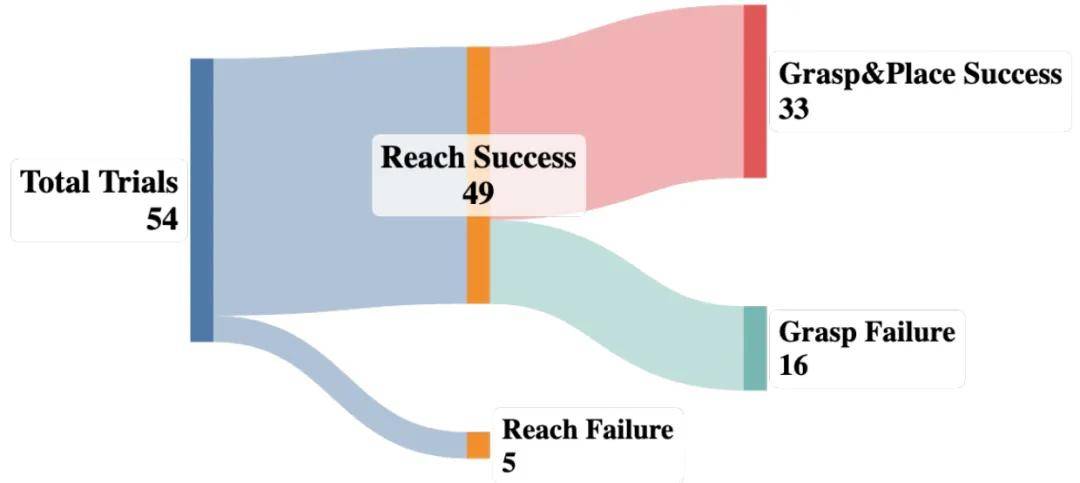

在全身灵巧抓取放置(WB-Dex)任务中,机器人能够弯腰从货架上拿起杯子,并精准放入地面的箱子里,在54次尝试中,49次成功到达目标位置,33次完整完成抓取放置动作,这一过程的核心难点在于对轻质物体的高精度抓取控制。

WB-Dex任务的成功与失败案例说明

WB-Dex任务的成功与失败案例说明

而在T型箱踢击(Kick-T)任务中,机器人用左脚将T型箱踢向目标区域后,还能及时上前右脚保持身体平衡,7次尝试中有6次成功,动作连贯且稳定,展现出出色的动态平衡能力与目标导向的动作协调能力。

值得注意的是,这是首个基于视觉实现人形机器人全身自主控制的框架,无需依赖简化的速度指令,可直接实现关节级别的精准控制。

▍结语:为人形机器人研究“降本增效”

TWIST2的核心价值,在于打破了“高质量人形机器人研究依赖昂贵设备”的壁垒。仅需约1650美元(VR设备+颈部+相机),就能搭建一套完整的全身遥操作与数据采集系统,20分钟即可完成上百次有效演示,还能训练出自主执行复杂任务的视觉运动策略。

目前研究团队已成功制造出3个TWIST2颈部模块,该颈部模块不仅易于组装,还可普及至科研领域供相关研究使用。随着系统、数据和模型的全面开源,TWIST2有望成为人形机器人研究的“基础设施”,让更多研究者聚焦于算法创新而非设备搭建,加速人形机器人走向通用化的进程。

论文地址:https://arxiv.org/pdf/2511.02832

项目地址:https://yanjieze.com/TWIST2/