原创 AI芯片独角兽获11亿美元融资,估值已达281亿美元!

当地时间2025年9月30日,号称业界性能最强的人工智能(AI)基础设施制造商Cerebras Systems宣布完成超额认购的11亿美元G轮融资,投后估值达81亿美元。

本轮融资由富达管理研究公司(Fidelity Management & Research Company)和Atreides Management领投。老虎环球基金(Tiger Global)、Valor Equity Partners和1789 Capital以及现有投资者Altimeter、Alpha Wave和Benchmark也参与了本轮融资。

作为全球最快的推理服务提供商,Cerebras 将利用这笔资金扩展其先锋技术组合,持续在 AI 处理器设计、封装、系统设计和 AI 超级计算机领域进行创新。此外,Cerebras 还将扩大其在美国的制造能力和数据中心容量,以满足市场对 Cerebras 产品和服务的爆炸式增长的需求。

Cerebras 联合创始人兼首席执行官 Andrew Feldman 表示:“自成立以来,我们一直得到业内最有见识的投资者的支持。他们看到了人工智能的历史性机遇,并选择投资 Cerebras。我们很荣幸能够扩大我们与全球顶尖投资者的联盟。”

Cerebras Systems的三代AI芯片

资料显示,Cerebras Systems是位于美国加州森尼韦尔市(Sunnyvale)的一家AI芯片公司,由公司CEO Andrew Feldman与Jean-Philippe Fricker、Michael James、Gary Lauterbach和Sean Lie等创始人于2016年创立。其中,Andrew Feldman曾创建微型服务器公司SeaMicro,并以3.34亿美元的价格卖给了AMD。

Cerebras公司认为,目前AI面临的挑战是如何将多组芯片连接起来,但又能兼顾能耗和处理速度。而Cerebras解决方案是制造一个巨型芯片,以更快地处理数据。Feldman指出,“传统策略是将一个大芯片切成小块,再把有瑕疵的小块扔掉。生产更大芯片较困难,且可能浪费珍贵的硅。公司开发的系统可让其芯片抵御瑕疵”。

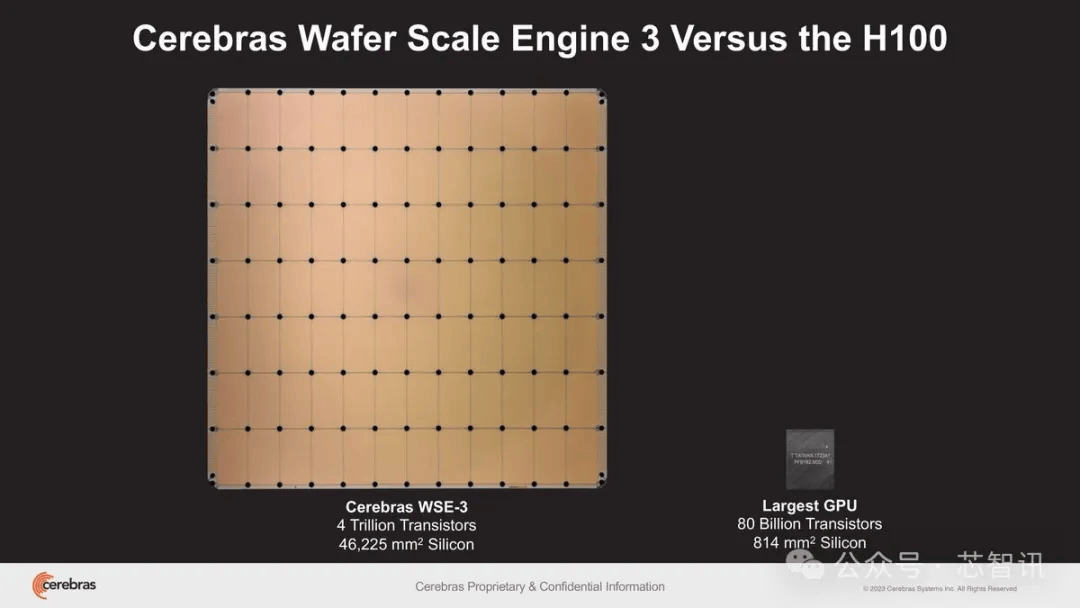

为此,在2019年8月,Cerebras推出了“世界上最大”的半导体AI芯片Wafer Scale Engine(以下简称“WSE”),其采用了一整张12英寸晶圆来制作,基于台积电16nm工艺,核心面积超过46225mm²,集成了高达1.2万亿个晶体管,拥有40多万个AI计算内核,以及高达18GB的片上SRAM内存。这也带来了超强的AI算力和超高的内存带宽,可以很好的应对各类AI加速任务。

随后在2021年4月,Cerebras推出了第二代的晶圆级AI芯片WSE-2,虽然芯片面积依然是462.25平方厘米,但是制程工艺由台积电16nm工艺提升到了7nm工艺,这也使得WSE-2的晶体管数量提高到了2.6万亿个,AI内核数量为85万个,片上内存SRAM为40GB,内存带宽为20PB/s,结构带宽高达220PB/s。

当时,Cerebras 还宣布,基于WSE-1的Cerebras CS 系列人工智能超级电脑在过去的一年中,已经被包括Argonne 国家实验室、Lawrence Livermore 国家实验室、匹兹堡超级计算机中心(PSC)、爱丁堡大学的超级电脑中心、东京电子设备公司(Tokyo Electron Devices)、制药产业大厂葛兰素史克(GlaxoSmithKline)等在内的知名机构部署。

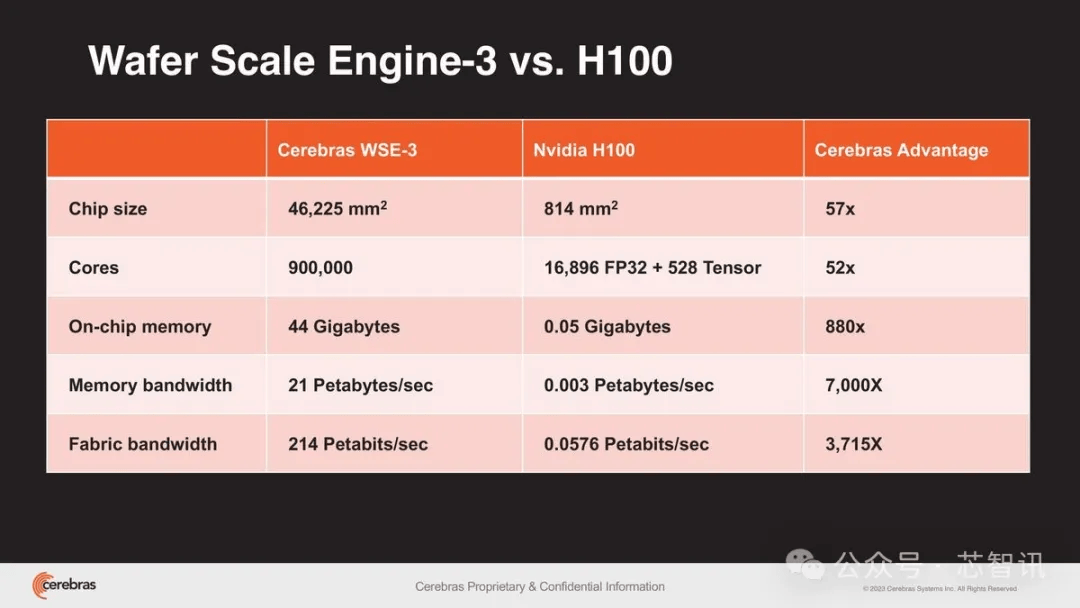

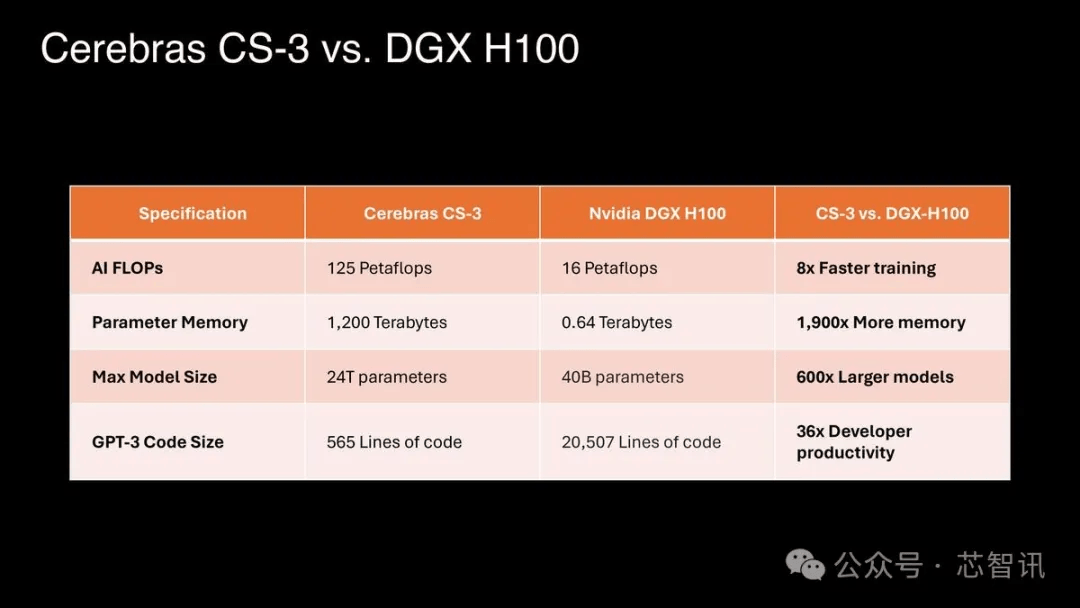

2024年3月,Cerebras又推出了其第三代的晶圆级AI芯片WSE-3,基于台积电5nm制程,芯片面积为46225平方毫米,拥有的晶体管数量达到了4万亿个,拥有90万个AI核心,44GB片上SRAM,整体的内存带宽为21PB/s,结构带宽高达214PB/s。使得WSE-3具有125 FP16 PetaFLOPS的峰值性能,性能达到了上一代WSE-2的两倍,可用于训练业内一些最大的人工智能模型。

尽管性能翻了一番,CS-3仍保持着与前代产品相同的功耗。它还简化了大型语言模型(LLM)的训练,与GPU相比,所需代码减少了97%。例如,该公司表示,GPT-3大小的模型在Cerebras平台上只需要565行代码。

性能遥遥领先英伟达GPU

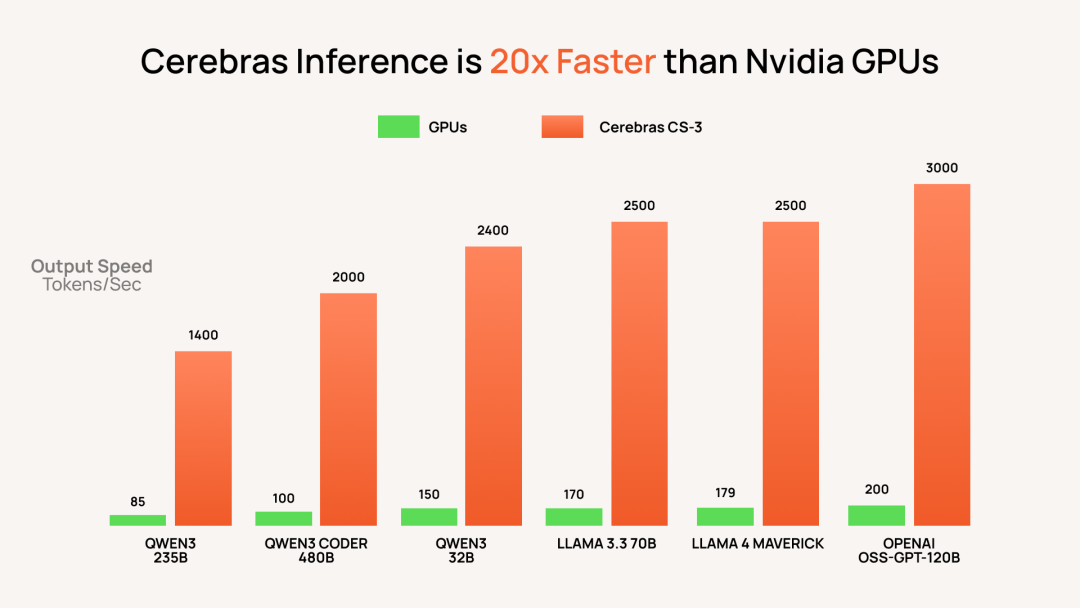

Cerebras 表示,自 2024 年底推出推理服务以来,公司经历了非凡的增长。在过去的一年里,Cerebras 每天都保持着性能冠军的宝座,在开源和闭源模型上,其速度通常比 Nvidia GPU 快 20 倍以上。

2025年5月底,Cerebras宣布基于其CS-3系统的云服务在400B参数的Llama 4 Maverick模型上创造了LLM推理速度的世界纪录,达到每个用户每秒2500个Token,这是英伟达DGX B200(包含了8个Blackwell GPU)系统的2.5倍。这项记录是由基准公司Artificial Analysis测得的。

“自成立以来,我们已经在数百种模型中测试了每个 AI 推理提供商。Cerebras 始终是最快的,”领先的基准测试公司 Artificial Analysis 的首席执行官 Micah Hill-Smith 表示。

Cerebras 的性能优势带来了巨大的需求。新的实时用例(包括代码生成、推理和代理工作)提升了速度带来的好处,并降低了速度慢的成本,从而吸引客户选择 Cerebras。如今,Cerebras 每月在其自有云平台、客户本地以及领先的合作伙伴平台上提供数万亿个代币。

Cerebras 在2024年披露的招股书显示,Cerebras 2022年营收2462万美元,亏损17772万美元;2023年收入7874 万美元,净亏损12716万美元;2024 年上半年营收为1.36亿美元,较去年同期的860万美元增加超过15倍。不过,2024年前六个月依然亏损了6,700万美元,比前一年同期7,800万美元略有减少。

阿联酋的AI厂商G42是Cerebras的最大客户。Cerebras是自2023年开始G42供应基于其AI芯片的超级电脑。根据Cerebras招股书,G42占该公司2024年上半年营收87%,G42也承诺2025年4月前将购买价值3.35亿美元Cerebras股票,持股比例超过5%。

Cerebras称,2025年,包括AWS、Meta、IBM、Mistral、Cognition、AlphaSense、Notion等数百家AI领军企业将选择Cerebras,加入葛兰素史克、梅奥诊所、美国能源部、美国国防部等企业和政府的行列。个人开发者也选择Cerebras进行AI开发。在领先的开发者AI中心Hugging Face上,Cerebras是排名第一的推理提供商,每月处理超过500万个请求。

编辑:芯智讯-浪客剑